بهینهسازی موتور جستجو: تفاوت میان نسخهها

جز 1 ویرایش خرابکارانهٔ 5.116.240.181 (بحث) به آخرین ویرایش Mehrdadvs واگردانی شد. ([[وپ:توینکل|توی... |

جز ←جستارهای وابسته: پیوند تبلیغاتی |

||

| خط ۶۹: | خط ۶۹: | ||

* [[فهرست موتورهای جستجو]] |

* [[فهرست موتورهای جستجو]] |

||

* [[بازاریابی موتورهای جستجو]] |

* [[بازاریابی موتورهای جستجو]] |

||

* [http://seo-web.pro/آموزش-نحوه-موفقیت-سایت-در-موتور-جستجو/ آموزش نحوه موفقیت سایت در موتور جستجو] |

|||

== منابع == |

== منابع == |

||

نسخهٔ ۳۰ سپتامبر ۲۰۱۵، ساعت ۲۲:۳۱

برای تأییدپذیری کامل این مقاله به منابع بیشتری نیاز است. (سپتامبر ۲۰۱۵) |

| بخشی از یک سری در |

| بازاریابی اینترنتی |

|---|

| بازاریابی موتورهای جستجو |

| Display advertising |

| فروش رابطهای |

| تبلیغات در تلفن همراه |

این مقاله نیازمند تمیزکاری است. لطفاً تا جای امکان آنرا از نظر املا، انشا، چیدمان و درستی بهتر کنید، سپس این برچسب را بردارید. محتویات این مقاله ممکن است غیر قابل اعتماد و نادرست یا جانبدارانه باشد یا قوانین حقوق پدیدآورندگان را نقض کرده باشد. |

این مقاله شامل فهرستی از منابع، کتب مرتبط یا پیوندهای بیرونی است، اما بهدلیل فقدان یادکردهای درونخطی، منابع آن همچنان مبهم هستند. |

بهینهسازی موتور جستجو (به انگلیسی: Search engine optimization)، یک روند مناسب برای بهبود دید یک وب سایت یا یک صفحه وب در یک موتور جستجوی طبیعی و یا الگوریتمی است. بطور کلی وب گاههایی که بالاترین مکان و بیشترین تکرار در صفحه نتایج جستجو را دارند، بازدید کننده بیشتری از طریق موتورهای جستجو بدست میآوردند. (SEO) توانایی انواع جستجو را دارد، از جمله: جستجوی تصاویر، مکانی، جستجوی ویدئو، جستجوی علمی، جستجوی خبری و صنعت خاص در رأس موتور جستجو هستند.

به عنوان یک استراتژی بازاریابی اینترنتی (SEO) به چگونگی کارکردن موتورهای جستجو و اینکه مردم چه چیزی را جستجو میکنند رسیدگی میکند و همینطور کلمات کلیدی تایپ شده و اینکه کدام یک از موتورهای جستجو توسط مخاطبان مورد توجه قرار میگیرد را مورد بررسی قرار میدهد. بهینهسازی وب سایت شامل توسعه مطالب موجود در خود سایت و HTML و برنامه نویسی مربوط به هر دو و همچنین ارتباط بین کلمات کلیدی و حذف موانع مربوط به فعالیتهای نمایه سازی در موتور جستجو و ترویج یک سایت برای افزایش تعداد لینک دهنده و یا لینکهای ورودی، از دیگر تاکتیکهای جستجوگرها است.

در کل (SEO) به معنی بهینهسازی موتور جستجو است و برای اطلاعات بیشتر میتوانید به افرادی که خدمات (SEO) را ارائه میدهند مراجعه کنید.

تاریخچه

از اواسط دهه ۱۹۹۰ میلادی که نخستین موتورهای جستجو اقدام به فهرست کردن وب اولیه کردند، مسئولان وب سایتها و تولیدکنندگان محتوا، شروع به بهینهسازی سایتها برای موتورهای جستجو نمودند. در ابتدا تمام کارهایی که مسئولان وب سایتها باید انجام میدادند، ارسال آدرس صفحه یا URL به موتورهای مختلفی که یک «عنکبوت» جهت «خزش» آن صفحه میفرستادند، استخراج لینکهای صفحه به سایر صفحات از درون صفحه، و بازگرداندن اطلاعات یافت شده در صفحه جهت ایندکس شدن بود. فرایند به این صورت است که عنکبوت موتور جستجو، یک صفحه را دانلود و آنرا در سرور موتور جستجو ذخیره میکند و یک برنامه دیگر موسوم به ایندکس کننده، اطلاعات مختلفی را دربارهٔ صفحه استخراج میکند؛ اطلاعاتی از قبیل واژههای موجود و محل قرارگیری آنها در صفحه، و نیز وزن خاص واژههای بخصوص، و تمام لینکهای موجود در صفحه، که سپس جهت خزش در زمانی دیگر، در دستور کار قرار میگیرد.

صاحبان سایتها شروع به بازشناسی ارزش رتبه بالای سایت خود و در دید قرارگرفتن آن در نتایج موتورهای جستجو نمودند که این امر، فرصتی را برای هکرهای غیر مخرب و مخرب شاغل در بخش بهینهسازی موتور جستجو مهیا کرد

طبق نظر یک تحلیل گر صنعتی به نام Danny Sullivan عبارت بهینهسازی موتور جستجو احتمالاً در سالهای ۱۹۹۷ مورد استفاده قرار گرفت. در ۲ ماه می ۲۰۰۷، Jason Gambert تلاش کرد تا دفتر ثبت علائم تجاری Arizona را متقاعد کند که (SEO) فرآیندی است شامل دستکاری واژگان کلیدی و نه یک سرویس بازاریابی و از این طریق واژه (SEO) را به عنوان علامت تجاری ثبت کند. وکیل بررسی کننده پرونده، استدلال نامنسجم وی را مبنی بر اینکه «وقتی (SEO) نمیتواند ثبت تجاری شود آن هم به دلیل اینکه به یک فرایند عمومی دستکاری واژگان کلیدی اتلاق میگردد، میتواند یک علامت خدماتی برای تأمین خدمات بازاریابی در حوزه کامپیوتر باشد».

نسخههای اولیه الگوریتمهای جستجو به اطلاعات فراهم شده توسط مسئولان وب سایتها نظیر meta tag واژههای کلیدی، یا فایل ایندکس موتورهای جستجو مانند ALIWEB اعتماد و اتکا میکردند متاتگها یک راهنمایی برای محتوای هر صفحه فراهم میکنند. با اینحال، استفاده از دادههای متا در صفحات ایندکس، کمتر قابل اطمینان بود زیرا انتخاب واژگان در یک متاتگ توسط مسئولان وب سایتها، بالقوه میتواند یک نمایش غیر دقیق از محتوای واقعی وب سایت باشد. دادههای نادرست، ناقص و ناسازگار در متا تگها میتواند موجب رتبه بندی شدن صفحه برای جستجوهای غیر مرتبط گردد. تولیدکنندگان محتوای شبکه همچنین تعدادی از ویژگیهای منبع HTML یک صفحه را دستکاری کردند تا رتبه صفحه را در موتورهای جستجو بهبود بدهند.

با تأکید بر عواملی مانند تراکم واژه کلیدی، که بطور انحصاری تحت کنترل مسئول وب سایت است، موتورهای جستجوی اولیه از سوء استفاده و دستکاری رتبه بندی رنج میبردند. به منظور ارائه نتایج بهتر به کاربران خود، موتورهای جستجو باید انطباق یافته و از نتایج صفحاتی اطمینان یابند که نتایج مرتبط تری دارند، نه نتایج مربوط به صفحاتی که نامربوط بوده و توسط مسئولان شبکه بدون وجدان کاری و با استفاده از کلمات کلیدی متعدد پر شدهاند. از آنجاییکه موفقیت و محبوبیت یک موتور جستجو از طریق توانایی آن در تولید نتایج مرتبط تر در قبال هر جستجوی صورت گرفته مشخص میشود، کیفیت پایین یا نتایج نامرتبط میتواند سبب سوق دادن کاربران به منابع جستجوی دیگر شود. موتورهای جستجو با توسعه الگوریتمی رتبه بندی پیچیدهتر به این عمل پاسخ دادند؛ که در آن عوامل بیشتری مورد توجه قرار میگیرند و دستکاری را برای مسئولان شبکه، سختتر میسازند. Larry page و Sergey Brin دو دانشجوی فارق التحصیل دانشگاه استنفورد یک موتور جستجو موسوم به Backrub را توسعه دادند که جهت ارزیابی برجستگی صفحات وب، به یک الگاریتم ریاضیاتی تکیه داشت. عدی که توسط الگوریتم محاسبه میشد، یعنی «رتبه صفحه»، تابعی است از مقدار و قدرت لینکهای ورودی. رتبه صفحه میزان یک صفحه معین را که توسط یک کاربر که بصورت تصادفی شبکه را جستجو میکند مورد دسترسی قرار گرفته، تخمین میزند و لینکهای یک صفحه به صفحه دیگر را دنبال میکند. در واقع، این بدان معناست که برخی لینکها از سایر لینکها قوی تر بوده، رتبه صفحه بالاتر احتمال دیده شدن صفحه توسط وب گردهای تصادفی را افزایش میدهد.

Page و Brin، Google را در سال ۱۹۹۸ بنیانگذاری کردند. Google درمیان کاربران فزاینده اینترنت، هواداران ثابت قدمی را به خود جذب کرد که طراحی ساده آن را دوست داشتند. عوامل خارج از صفحه (مانند رتبه صفحه و تجزیه تحلیل لینک) نیز همانند عوامل داخل صفحه (فراوانی واژههای کلیدی، متاتگها، عنوانها، لینک و ساختار وب سایت) مورد توجه قرار گرفتند تا گوگل را قادر به این امر سازند که از نوعی دستکاری که در موتورهای جستجویی دیده میشود که تنها به عوامل داخل صفحه توجه میکنند، اجتناب نماید. علیرغم اینکه به بازی گرفتن رتبه صفحه سختتر بود، مسئولان شبکه سرانجام ابزارها و طرحهای تولید لینک را جهت تحت تأثیر قرار دادن موتور جستجوی Inktomi توسعه دادند، و این روشها ثابت کردند که به طریقی مشابه میتوان رتبه صفحه را تحت تأثیر قرار داد. بسیاری از وب سایتها روی تبادل، خرید و فروش لینک در حجم زیاد و وسیع متمرکز هستند. بعضی از این طرحها یا مزارع لینک، موجب ایجاد هزاران وب سایت برای فروش هرزنگاری لینکها میشوند.

تا سال ۲۰۰۴، موتورهای جستجو، طیف گستردهای از عوامل نامعلوم را در الگوریتمهای رتبه بندی خود جای داده بودند تا اثر دستکاری لینکها را کاهش دهند. در ژوئن ۲۰۰۷، یک گزارشگر از نیویورک تایمز بنام Saul Hansell گفت که گوگل، رتبه بندی سایتها را با استفاده از بیش ۲۰۰ علامت مختلف انجام میدهد. موتورهای جستجوی پیشرو یعنی Google , Bing , Yahoo الگوریتمهای رتبه بندیهای خود را افشا نمیکنند. برخی از شاغلان در SEO روشهای مختلفی را جهت بهینهسازی موتور جستجو مورد مطالعه قرار داده و نظرات شخصی خود را منتشر نمودهاند. ثبت اختراعهای مربوط به موتورهای جستجو میتواند اطلاعاتی را برای درک بهتر موتورهای جستجو فراهم نماید.

در سال ۲۰۰۵، شروع به شخصی سازی نتایج جستجو برای هر کاربر نمود. بر اساس تاریخچه جستجوهای قبلی آنها، گوگل اقدام به ایجاد نتایج برای کاربرانی نمود که وارد حساب کاربری خود شدهاند. در سال ۲۰۰۸، Bruce Clay گفت که «رتبه بندی مرده است» زیرا جستجوی شخصی شده سبب آن میگردد. او احضار کرد که بحث در مورد نحوه رتبه بندی یک وب سایت بیمعنی است؛ زیرا رتبه یک وب سایت، بالقوه برای هر کاربر و هر جستجو میتواند متفاوت باشد.

در سال ۲۰۰۷، گوگل کمپینی به راه انداخت علیه لینکهایی که در ازای پرداخت پول، رتبه صفحه را منتقل میکنند. در ۱۵ ژوئن ۲۰۰۹، گوگل فاش کرد که اقداماتی در پیش گرفته تا با استفاده از ویژگیهای nofollow در لینکها، اثر مدلسازی رتبه صفحه را کاهش دهد. Matt Cutts یک مهندس نرمافزار شناخته شده در گوگل، اعلام کرد که عنکبوت خزنده گوگل دیگر به طریق مشابه به لینکهای دنبال نشده نمیپردازد تا تأمین کنندگان خدمات SEO را از استفاده از آن در تعیین مدلسازی رتبه صفحه منع نماید. در نتیجه این تغییر استفاده از nofollow منجر به از دست رفتن رتبه صفحه میشود. به منظور اجتناب از این امر، مهندسان SEO تکنیکهای جایگزینی را توسعه دادند که تگهای nofollow شده را با Javascript مبهم جایگزین کرده و در نتیجه، مدلسازی رتبه صفحه را میسر میسازد. بعلاوه چند راه حل پیشنهاد شده است که شامل استفاده از iframes , Flash , Javascript میشود.

در دسامبر ۲۰۰۹، گوگل اعلام کرد که از سوابق جستجوی تمام کاربرانش جهت جمعآوری نتایج جستجو استفاده خواهد کرد.

در ۸ ژوئن ۲۰۱۰ از یک سیستم ایندکس گذاری جدید موسوم به گوگل کافئین رونمایی شد. گوگل کافئین تغییری بود در روش به روز شدن ایندکس گوگل به منظور نمایش سریعتر نتایج گوگل نسبت به گذشته. این سیستم طراحی شد تا به کاربرها اجازه یافتن سریعتر از قبل نتایج جدید، پستهای فورمها و سایر مطالب را بلافاصله پس از انتشار آنها بدهد. Carrie Grimes مهندس نرمافزاری که به گوگل، سیستم کافئین را معرفی کرد، معتقد است که این سیستم جستجوهای شبکه را ۵۰ درصد نسبت به ایندکس پیشین بهبود میدهد.

Google Instant، یا جستجوی زمان واقعی، در اواخر سال ۲۰۱۰ در تلاشی به منظور بهنگام تر و مرتبط نمودن جستجوها ارائه شد. بطور تاریخی، ادمینهای وب سایتها، ماهها و یا حتی سالها روی بهینهسازی یک وب سایت و ارتقای رتبهٔ جستجوی آن زمان گذاشتهاند. با گسترش عمومیت وب سایتها و وبلاگهای رسانههای اجتماعی، موتورهای جستجوی پیشرفته در الگوریتمهای خود تغییراتی ایجاد کردند تا مطالب تازه به سرعت در میان نتایج جستجو رتبه بندی شوند.

در فوریه ۲۰۱۱، از آپدیت پاندا خبر داد که وب سایتهایی را که حاوی محتوای تکثیر شده از وب سایتها و منابع دیگر باشند، جریمه میکند. بطور تاریخی، وب سایتها محتوا را از یکدیگر کپی کرده و از آن در رتبه بندی موتورهای جستجو بهرهمند شدهاند. با این حال، گوگل یک سیستم جدید پیادهسازی کرد که سایتهایی را که حاوی محتوای منحصر به فرد نیستند، جریمه میکند.

در آوریل ۲۰۱۲، گوگل از آپدیت گوگل پنگوئن رونمایی کرد که هدف آن، جریمه کردن وب سایتهایی بود که از روشهای دستکاری جهت بهبود رتبه خود در موتورهای جستجو استفاده میکردند.

در سپتامبر ۲۰۱۳، کمپانی گوگل از آپدیت Google Hummingbird رونمایی کرد؛ یک الگوریتم که جهت بهبود پردازش زبان طبیعی گوگل و درک معنایی صفحات وب طراحی شد.

ارتباط با موتورهای جستجو

تا سال ۱۹۹۷، طراحان موتورهای جستجو دریافتند که مسئولان وب سایتها تلاش میکنند که در موتورهای جستجوی آنها رتبه بهتری داشته باشند. آنان همچنین متوجه شدند که برخی از مدیران وب، حتی رتبههای خود در نتایج جستجو را از طریق لبریز نمودن صفحات خود با واژگان کلیدی بسیار زیاد یا نامرتبط، دستکاری میکردند. موتورهای جستجوی اولیه، نظیر آلتا ویستا یا اینفوسیک، الگوریتمهای خود را جهت جلوگیری مدیران وب در دستکاری رتبهها، مجدداً سازگار کردند.

در سال ۲۰۰۵، یک کنفرانس سالانه موسوم به بازیابی اطلاعات خصمانه در وب (AIRWeb) تا شاغلان و محققان مرتبط با موتورهای جستجو و بهینهسازی آن را به هم مرتبط سازد.

وب سایتهای مشتری کمپانیهایی که از تکنیکهای بیش از حد تهاجمی استفاده میکنند، میتوانند در نتایج جستجو مسدود گردد. در سال ۲۰۰۵، Wall Street Journal گزارش داد که کمپانی Traffic Power، به گفته برخی افراد، از تکنیکهای دارای ریسک بالا استفاده کرده و آنرا به مشتریهای خود اطلاع نداده است. مجله Wired گزارش داد که همان کمپانی از Aaron Wall، وبلاگ نویس و SEO، بخاطر نوشتن در مورد بستن و تحریم شکایت کرده است. Matt Cutts از کمپانی گوگل بعدها تأیید کرد که گوگل عمداً شرکت Traffic Power و برخی از مشتریان آنرا توقیف کرده است.

برخی از موتورهای جستجو نیز به صنعت SEO دست زده و تبدیل به حامیان مالی پر رفت و آمد و مهمان در کنفرانسها، چتها و سمینارهای SEO شدهاند. موتورهای جستجوی اصلی، اطلاعات و دستورالعملهای چگونگی بهینهسازی وب سایت را فراهم میسازند. کمپانی گوگل برای کمک به مدیران شبکه، یک برنامه نقشه سایت دارد که در صورت وجود هر مشکلی در ایندکس نمودن وب سایتهای مدیران شبکه، به آنها اطلاع داده و نیز دادههای ترافیک گوگل مربوط به وب سایت آنها را در اختیارشان قرار میدهد. Bing Webmaster Tools به مدیران شبکه امکان ارسال یک نقشه سایت و فیدهای شبکه را داده و کاربرها را نیز قادر به تشخیص میزان خزش ردیابی وضعیت ایندکس صفحات وب میسازد.

روشها

فهرستشدن

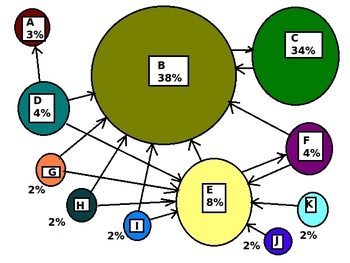

توجه: درصدها گرد شدهاند.

موتورهای جستجوی پیشرو مانند جستجوگر گوگل، بینگ، یاهو! جستجو از خزندهها جهت پیدا کردن صفحات مرتبط با نتایج جستجوی الگوریتمیک خود استفاده میکنند. صفحاتی که از صفحات ایندکس شده یک موتور جستجوی دیگر لینک میشوند، نیازی به ارسال ندارد زیرا بطور خودکار پیدا میشوند.

دو دایرکتوری عمده Yahoo Directory , دیموز نیازمند ارسال دستی و بازنگری انسانی هستند. شرکت گوگل Google Webmaster Tools را پیشنهاد میدهد که یک فید نقشه سایت اکسامال میتواند برای آن ایجاد و بطور رایگان ارسال شود تا این اطمینان حاصل شود که تمامی صفحات خصوصاً آنهایی که با دنبال کردن خودکار لینکها قابل شناسایی نیستند، قابل دستیابی هستند. در گذشته یاهو! یک سرویس ارسال پرداختی داشت که خزش را به ازای مقداری هزینه در هر کلیک تضمین میکرد که در سال ۲۰۰۹، این سرویس متوقف شد

خزندههای موتور جستجو میتوانند هنگام خزش یک وب سایت، به تعداد عوامل مختلفی توجه کنند. هر صفحهای توسط موتور جستجو ایندکس نمیشود. فاصله صفحات از دایرکتوری اساسی ممکن است یک عامل در خزش یا عدم خزش در صفحات باشد.

جلوگیری از خزش

به منظور جلوگیری از محتوای نامطلوب در ایندکسهای جستجو، مدیران شبکه میتوانند به عنکبوتها دستور بدهند که فایلها یا دایرکتوریهای خاصی را درون فایل استاندارد robots.txt در دایرکتوری اصلی دامنه، مورد بررسی و خزش قرار ندهند. بعلاوه، یک صفحه میتواند صراحتاً از پایگاهدادهها مورد جستجو خارج شود که این عمل از طریق استفاده از متاتگهای مخصوص به رباتها صورت میگیرد. هنگامی که یک موتور جستجو از یک سایت بازدید میکند فایل robots.txt واقع در دایرکتوری اصلی، نخستین جایی است که مورد خزش قرار میگیرد. سپس فایل robots.txt تجزیه شده و به ربات دستور داده میشود که کدام صفحات نباید مورد بررسی و خزش قرار میگیرد. از آنجایی که خزنده موتور جستجو ممکن است که یک نسخه از این فایل را نگه دارد گاهی ممکن است که صفحاتی مورد خزش قرار میگیرند که مدیر شبکه تمایلی به آنها ندارد. بطور معمول، صفحاتی که از خزش خارج میشوند عبارتند از صفحات ورودی خاص مانند صفحات مربوط به کارتهای خرید و صفحات مربوط به محتوای شخصی کاربر نظیر نتایج جستجوی حاصل از جستجوهای داخلی. در مارس ۲۰۰۷، گوگل به مدیران شبکه هشدار داد که باید از ایندکس شدن نتایج جستجوی داخلی جلوگیری کنند زیرا این صفحات، هرزنامه جستجو هستند.

افزایش برتری

روشهای گوناگونی میتوانند برتری یک صفحه وب را در میان ننتایج جستجو افزایش دهند. لینک کردن متقابل صفحات یک وب سایت جهت فراهم نمودن لینکهای بیشتر به صفحات مهمتر، میتواند شانس در دید بودن آن را افزایش دهد. نوشتن محتوایی که شامل کلمات کلیدی باشد، به نحوی که متن حاصل، به طیف گستردهای از ورودیهای جستجو مرتبط باشد، میتواند سبب افزایش ترافیک شود. به روز رسانی محتوا بمنظور خزش مکرر توسط موتورهای جستجو میتواند یک وزن اضافی به سایت بدهد. اضافه نمودن کلمات کلیدی مرتبط با فرا دادههایی که یک صفحه وب شامل تگ عنوان و فرا توضیح، میتواند منجر به بهبود رابطه لیستهای جستجوی یک وب سایت و در نتیجه افزایش ترافیک شود. نرمالیزه کردن نشانی اینترنتی صفحات وب در دسترس نشانیهای اینترنتی متعدد، با استفاده از عنصر لینک متعارف یا از طریق ریدایرکتهای ۳۰۱، میتواند این اطمینان را فراهم آورد که لینک به نسخههای مختلف URL جهت محاسبه نمره محبوبیت لینک صفحه، مورد توجه و استفاده قرار میگیرد.

تکنیکهای کلاه سفید در مقابل تکنیکهای کلاه سیاه

تکنیکهای SEO میتوانند به دو گروه عمده طبقهبندی شوند: تکنیکهایی که موتورهای جستجو به عنوان بخشی از یک طراحی خوب توصیه میکنند، و تکنیکهایی که مورد تأیید موتورهای جستجو نیست. موتورهای جستجو تلاش میکنند که اثر دسته دوم را کاهش دهند هرز آگهیها از آن جمله هستند. مفسران صنعتی و شاغلانی که از این تکنیکهای SEO استفاده میکنند، آنها را به SEO کلاه سفید یا کلاه سیاه طبقهبندی کردهاند. تکنیکهای کلاه سفید تمایل به تولید نتایجی دارند که مدت زمان زیادی برقرار هستند، در حالیکه تکنیکهای کلاه سیاه پیش بینی میکنند که وب سایتهای آنها در نهایت ممکن است بطور موقت یا دائم توقف گردد؛ هنگامی که موتورهای جستجو سر از کارشان درآورند. یک تکنیک SEO کلاه سفید تلقی میشود، اگر از دستور العملهای موجود جستجو پیروی کرده و فریبی در کارش نباشد. از آنجاییکه دستورالعملهای موتور جستجو به عنوان مجموعهای از قوانین نوشته نشده است، این یک تمایز مهم و قابل توجه است.

تکنیک SEO کلاه سفید تنها دربارهٔ تبعیت از دستورالعملها نیست، اما در مورد حصول اطمینان از این امر است که محتوایی که یک موتور جستجو ایندکس کرده و سپس رتبه بندی میکند، مشابه همان محتوایی باشد که یک کاربر خواهد دید. مشاوره کلاه سفید در مجموع جهت ایجاد محتوا برای کاربران مورد استفاده قرار میگیرد، نه برای موتورهای جستجو. سپس، آن محتوا به جای تلاش جهت تحریک نمودن الگوریتم و فریب دادن آن از اهداف مورد نظر خود، به سادگی در دسترس عنکبوتها قرار میگیرد. تکنیکهای کلاه سفید در بسیاری جهات شبیه توسعه وب هستند که در دسترس بودن را ارتقاء میدهد؛ هرچند که این دو یکسان نیستند.

تکنیکهای SEO کلاه سیاه تلاش میکنند تا رتبه بندی را از طریق فریب از روشها و راههایی که مورد تأیید موتور جستجو نیست، بهبود دهند. یک تکنیک کلاه سیاه از متن پنهان شده به عنوان متن رنگ آمیز شده مشابه با پس زمینه یک div نامرئی، یا بعنوان متنی در خارج از صفحه نمایش استفاده میکنند. تکنیک دیگر، تکنیکی موسوم به cloaking است که بسته به اینکه یک صفحه توسط بازدید کننده انسانی فراخوانی شود یا توسط یک موتور جستجو، صفحه متفاوتی را بدست میدهد.

دسته دیگری که گاهی مورد استفاده قرار میگیرد، SEO کلاه خاکستری است. این تکنیک بین کلاه سفید و سیاه است که از روشهایی استفاده میکند که از مجازات سایت جلوگیری میکند، اما با این وجود، بهترین محتوا را برای کاربر مهیا نکرده و ترجیحاً روی بهبود رتبه بندیهای موتور جستجو تمرکز میکند.

موتورهای جستجو ممکن است سایتهایی را که از روشهای کلاه سیاه استفاده میکنند را جریمه کنند، که این امر از طریق کاهش دادن رتبه آنها، یا حذف کردن لیستهای آنها از databaseهای خود و یا همه موارد میتواند صورت گیرد. چنین مجازاتهایی میتوانند بطور خودکار توسط الگوریتمهای موتور جستجو یا از طریق بازنگری دستی سایت صورت پذیرد. یک نمونه، حذف Ricoh Germany , BMW Germany از گوگل در فوریه ۲۰۰۶ به دلیل استفاده از شیوههای فریبنده بود. با این حال، هر دو کمپانی به سرعت عذرخواهی کرده و با اصلاح نمودن صفحات متخلف، به لیست گوگل بازگشتند.

به عنوان یک استراتژی بازاریابی

SEO یک روش و استراتژی بازاریابی مناسب برای همه وب سایتها نیست و بر اساس هدف گردانندگان یک وب سایت، استراتژیهای بازاریابی اینترنتی دیگر مانند تبلیغات از طریق پرداخت کلیکی (PPC) میتواند مؤثرتر باشد. همچنین، یک کمپین تبلیغات اینترنتی موفق میتواند به ساختن صفحات وب دارای کیفیت بالا بستگی داشته باشد که بکارگیری نرمافزارهای تحلیل را ترغیب مینماید تا صاحبان سایتها قادر به ارزیابی نتایج، و بهبود نرخ تبدیل سایت شوند.

SEO ممکن است بازگشت سرمایه مناسب و کافی بدست دهد. با این حال، موتورهای جستجو بخاطر ترافیک جستجوی اصلی وجهی دریافت نمیکنند، الگوریتمهای آنها تغییر میکند و تضمینی برای ارجاعات پیوسته آنها وجود ندارد. با توجه به این عدم تضمین و اطمینان، کسب و کاری که شدیداً وابسته به ترافیک موتور جستجو است، میتواند دچار زیانهای عمده ایی شود؛ اگر موتور جستجو از فرستادن بازدیدکننده دست بکشند. موتورهای جستجو میتوانند الگوریتمهای خود را تغییر داده، جایگاه یک سایت را تحت تأثیر قرار دهند و احتمالاً در از دست دادن جدی ترافیک یک سایت، نقش ایفا کنند. بر اساس اعلام Eric Schmidt مدیر عامل گوگل، این کمپانی در سال ۲۰۱۰ بیش از ۵۰۰ تغییر در الگوریتم خود ایجاد کرده است؛ یعنی حدود ۵/۱ تغییر در هر روز. این یک اقدام کاری عاقلانه برای اپراتورهای وب سایتها است که خود را از وابستگی به ترافیک موتور جستجو رها نمایند.

بازارهای بینالمللی

تکنیکهای بهینهسازی شدیداً متناسب با موتورهای جستجو غالب در بازار هدف تنظیم میشوند. سهام بازار موتورهای جستجو از بازاری به بازاری دیگر و مانند وجود یک رقابت، تغییر میکنند. در سال ۲۰۰۳، Danny Sullivan اظهار کرد که گوگل حدود ۷۵ درصد کل جستجوها را انجام داده است. در بازارهای خارج از آمریکا، سهم گوگل اغلب بیشتر است و از سال ۲۰۰۷، گوگل در جایگاه موتور جستجوی غالب در سراسر جهان باقیمانده است. از سال ۲۰۰۶، گوگل ۸۵ تا ۹۰ درصد سهم بازار آلمان را در اختیار دارد. در حالیکه صدها شرکت SEO در آن زمان در آمریکا وجود داشت، فقط حدود ۵ مورد از آن در آلمان کار میکرد. از ژوئن ۲۰۰۸، بر اساس اعلام Hitwise، سهم گوگل از بازار بریتانیا نزدیک به ۹۰ درصد بوده است. آن عدد از طریق چند کشور حاصل میشود.

از سال ۲۰۰۹، تنها چند بازار بزرگ وجود دارد که گوگل در آنها، موتور جستجوی پیشرو نیست. در اغلب موارد، هنگامی که گوگل در یک بازار خاص، پیشرو نیست، پشت سر یک رقیب محلی قرار دارد. قابل توجهترین نمونههای این موارد، کشورهای چین، ژاپن، کره جنوبی، روسیه و جمهوری چک هستند که به ترتیب، Baidu , Yahoo! , Japan , Naver , Yandex و Seznam پیش روی بازارها هستند.

بهینهسازی جستجوی موفق برای بازارهای بینالمللی، ممکن است نیازمند ترجمه حرفهای صفحات وب، ثبت یک دامنه با یک دامنه سطح بالا در بازار هدف و میزبانی است که آدرس IP محلی را فراهم نماید. در غیر این صورت، بدون توجه به زمان، عناصر اساسی بهینهسازی جستجو، اساساً مشابه هستند.

سوابق حقوقی

در ۱۷ اکتبر ۲۰۰۲، Seaerchking در دادگاه منطقهای آمریکا در منطقه غربی Oklahoma، دادخواستی علیه موتور جستجوی گوگل داد. او ادعا کرد که تاکتیکها و روشهای گوگل در جلوگیری از هرزآگهیها، موجب ایجاد یک تداخل زیان آور با روابط قراردادی شده است. در ۲۷ می ۲۰۰۳، دادگاه شکایت علیه گوگل را رد کرد زیرا Seaerchking نتوانست ادعایش را که میتوانست منجر به دریافت خسارت شود، اثبات کند.

در مارس ۲۰۰۶، KinderStart به دلیل رتبه بندیهای موتور جستجوی گوگل، در دادگاه طرح دعوی کرد. پیش از این اقامه دعوی، وب سایت KinderStart از ایندکس گوگل خارج شد و ترافیک سایت تا ۷۰ درصد کاهش یافت. در ۱۶ مارس ۲۰۰۷، دادگاه منطقهای آمریکا در منطقه شمالی کالیفرنیا (بخش San Jose) شکایت KinderStart را رد کرده و این شرکت را مکلف به پرداخت بخشی از هزینههای حقوقی گوگل کرد.

جستارهای وابسته

منابع

- مشارکتکنندگان ویکیپدیا. «Search engine optimization». در دانشنامهٔ ویکیپدیای انگلیسی، بازبینیشده در ۴ فوریه ۲۰۱۵.

پیوند به بیرون

- Google Webmaster Guidelines

- Yahoo! Webmaster Guidelines

- Bing Webmaster Guidelines

- "The Dirty Little Secrets of Search," article in نیویورک تایمز (۱۲ فوریه ۲۰۱۱)

- Google I/O 2010 – SEO site advice from the experts در یوتیوب – Technical tutorial on search engine optimization, given at گوگل آی/او ۲۰۱۰.

- "آموزش بهینه سازی و سئو,"