T-sne کاهش ابعاد داده

t-SNE یک الگوریتم تجزیه و تحلیل دادههای چند بعدی است که برای تصویرسازی دادهها در فضایی با بعد کمتر(عموما دو بعدی یا سه بعدی) استفاده میشود و اولینبار، توسط لورنس ون در ماتن و جفری هینتون در سال ۲۰۰۸ معرفی شده است[۱][۲].

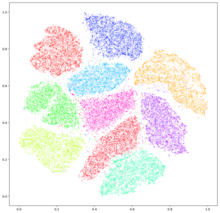

با استفاده از t-SNE، میتوان دادههای پیچیده و چند بعدی را به صورت یکنواخت و منظم در فضای کاهشیافته نشان داد. این الگوریتم باعث ایجاد فضای جدیدی میشود که در آن دادههای مشابه به هم نزدیک و دادههای متفاوت از هم دور قرار میگیرند. به عبارت دیگر، دادههایی که در فضای اصلی به هم نزدیک بودند، در فضای کاهشیافته نیز به هم نزدیک باقی میمانند و دادههایی که در فضای اصلی دور از هم بودند، در فضای کاهشیافته نیز دور از هم قرار میگیرند.

t-SNE برای تصویرسازی دادههایی که به صورت غیرخطی در فضای چند بعدی نشان داده میشوند، بسیار مناسب است. این الگوریتم برای کاهش ابعاد دادههای پیچیده، مانند تصاویر و دادههای صوتی، نیز کارآمد است.

در کل، t-SNE یک الگوریتم کارآمد و مفید برای تصویرسازی دادههاست که به صورت گسترده در حوزههای مختلف مانند علم داده، بینایی ماشین، آمار، ژنومیک، امنیت سایبری، پردازش زبان طبیعی، تحلیل موسیقی، تحقیقات سرطان، بیوانفورماتیک، تفسیر ژئولوژی، و پردازش سیگنال های پزشکی و ... استفاده میشود.

مقدمه[ویرایش]

این الگوریتم با محاسبه ماتریس شباهت بین دادههای مختلف(به صورت پیشفرض بر اساس فاصله اقلیدسی)، شروع به کاهش ابعاد دادهها میکند و با استفاده از توزیع احتمال برای جفت دادهها در فضای بالا بعد و فضای پایین بعد، کاهش بعد را انجام میدهد. سپس با کمینه کردن فاصله بین این دو توزیع احتمال با استفاده از الگوریتم گرادیان کاهشی، سعی در حفظ ساختار محلی فضای بالا بعد اصلی دارد.

نتیجهی این الگوریتم، نمایشی بهتر و کاهش بعد دادهها در فضای پایین بعد است. دادههایی که در فضای بالا بعد به هم نزدیک بودهاند، در فضای پایین بعد نیز به هم نزدیک باقی خواهند ماند و دادههایی که در فضای بالا بعد دور از هم بودهاند، در فضای پایین بعد نیز دور از هم خواهند بود.

یکی از مزایای t-SNE، توانایی آن در درک روابط غیرخطی بین دادهها است که این الگوریتم را برای تصویرسازی دادههای پیچیده مانند تصاویر و فایلهای صوتی مناسب میسازد. با این حال، این الگوریتم پردازشی هزینهبر است و نیاز به تنظیم دقیق پارامترهای آن دارد تا نتایج بهتری حاصل شود.

جزئیات الگوریتم[ویرایش]

t-SNE، با استفاده از یک روش دو مرحلهای، نقاط با ویژگیهای مشابه را در نزدیکی یکدیگر و نقاط با ویژگیهای متفاوت را در فاصلهای دور از یکدیگر قرار میدهد. در این روش، توزیع احتمالاتی ابتدا بر اساس فاصلههای اقلیدسی بین نقاط در فضای بالابعد ساخته میشود. سپس، با ساخت یک توزیع احتمالاتی مشابه در فضای پایینبعد و کاهش اختلاف کولبک-لایبلر ، نموداری از دادههای پایینبعد ایجاد میکند.

با داشتن مجموعهای از شیء با بعد بالا به عنوان ورودی، t-SNE ابتدا احتمالات را محاسبه میکند که نسبت مستقیم با شباهت شیء و دارند.

برای ، این احتمالات با استفاده از فرمول زیر محاسبه میشوند:

توجه داشته باشید که و برای هر ، مجموع است.

همانطور که ون در ماتن و هینتون توضیح دادهاند: "شباهت نقطهی نسبت به نقطهی ، احتمال شرطی است، که در آن نقطه را به عنوان همسایهاش انتخاب میکند اگر همسایهها بر اساس چگالی احتمال خود تحت یک گوسی با مرکز ، انتخاب شوند."[۲]

حالا میتوانیم را به صورت زیر تعریف کنیم:

این ایده به این دلیل مطرح شده است که و در نمونه، با تخمین زده میشوند؛ بنابراین احتمال شرطی میتواند به صورت و نوشته شود؛ و از آنجا که ، فرمول قبلی بدست میآید.

همچنین توجه داشته باشید که و .

پهنای توابع گاوسی، به گونهای تعیین میشود که آنتروپی توزیع شرطی برابر با یک آنتروپی از پیش تعریف شده با استفاده از روش دوبخشی باشد. در نتیجه، با چگالی دادهها متناسب است: مقادیر کوچکتری از در قسمتهای چگالتر فضای دادهها استفاده میشود.

هدف t-SNE این است که نقشهی d-بعدی (که در آن و d معمولاً به عنوان 2 یا 3 انتخاب میشود) را یاد بگیرد که شباهتهای را به بهترین شکل ممکن بازتاب میدهد. برای این منظور، این الگوریتم شباهتهای بین دو نقطه در نقشه و را با استفاده از روشی بسیار مشابه اندازهگیری میکند. به طور خاص، برای ، را به صورت زیر تعریف میکنیم:

و را صفر قرار میدهیم. در اینجا از یک توزیع تی-استیودنت(با درجه آزادی برابر یک، مشابه توزیع کوشی) برای اندازهگیری شباهتها بین نقاط با بعد کم استفاده میشود تا امکان قرار گرفتن اشیاء نامشابه در فاصلههای دور در نقشه فراهم شود.

مکان نقاط در نقشه با کمینه کردن اختلاف کولبک-لایبلر غیرمتقارن توزیع P از توزیع Q به دست میآید، یعنی:

کمینهسازی اختلاف کولبک-لایبلر با توجه به نقاط ، با استفاده از روش گرادیان کاهشی انجام میشود. نتیجهی این بهینهسازی، نقشهای است که شباهتها بین ورودیهای با بعد بالا را بازتاب میدهد.

منابع[ویرایش]

- ↑ Roweis, Sam; Hinton, Geoffrey (January 2002). Stochastic neighbor embedding (PDF). Neural Information Processing Systems.

- ↑ ۲٫۰ ۲٫۱ van der Maaten, L.J.P.; Hinton, G.E. (Nov 2008). "Visualizing Data Using t-SNE" (PDF). Journal of Machine Learning Research. 9: 2579–2605.