نظارت ضعیف

نظارت ضعیف (به انگلیسی: Weak Supervision) شاخهای از یادگیری ماشین است که در آن منابع نویز دار، محدود یا با دقت پایین برای ایجاد سیگنالهای نظارتی مربوط به برچسب زدن روی حجم انبوهی از دادهٔ آموزش درون یک محیط یادگیری نظارتشده اعمال میشود.[۱] این روش هزینههای احتمالیای که لیبل زدن به صورت دستی ایجاد میکند مانند زمانبر بودن را از بین میبرد. به جای این روش برچسبهای ضعیف و درک آن که آنها ناقصند اما میتوانند یک مدل قوی بسازند بهکارگرفته میشوند.[۲]

به خصوص در پردازش زبانهای طبیعی که در آن ما الگوهای بسیاری خاص برای دادهها داریم که باعث میشود یک مدل از پیش آموزش دیده با الگوهای خاص به خوبی عمل نکند، در این مورد نظارت ضعیف به بهبود عملکرد مدل در مورد الگوها کمک میکند.[۳][۴]

سطوح نشانه گذاری دادهها[ویرایش]

در کل سطوح نشانه گذاری دادهها را میتوان به ۳ گروه تقسیم کرد:

دادههای نشانهگذاری شده با کیفیت بالا[ویرایش]

در این بخش دادهها با کیفیت خوبی نشانهگذاری شدهاند و این نشانهگذاریها قابل اعتماد هستند.

با توجه به اندازهٔ مجموعه دادهها در این گروه میتوان از رویکردهای مختلف استفاده کرد؛ مثلاً اگر اندازهٔ مجموعه داده بزرگ باشد میتوان از رویکرد یادگیری بانظارت و اگر اندازه مجموعه داده کوچک باشد میتوان از رویکرد یادگیری انتقالی یا یادگیری نیمه نظارتی استفاده کرد.

دادههای نشانهگذاری شده با کیفیت پایین[ویرایش]

در این بخش با تکنیکهای مختلف مثل روشهای برچسبگذاری ضعیف، روشهای اکتشافی الگو یابی، برچسبگذاری خوشه ای و استفاده از مدلهای از قبل آموزش دیده به عنوان یک پیشبینی کننده نویز دار، کیفیت نشانهگذاری را بالا میبریم و سپس از روشهای ذکر شده استفاده میکنیم.

دادههای بدون نشانهگذاری[ویرایش]

در این بخش میتوان از روشهای خوشهبندی استفاده کرد.

مسئلهٔ دادهٔ آموزش برچسبدار[ویرایش]

مدلهای یادگیری ماشین و تکنیکهای آن به صورت روبهافزایشی قابلدسترسی توسط محققان و توسعهدهندگان است.[۵] کاربرد این مدلها در دنیای واقعی اما، بستگی به دسترسی به دادهٔ آموزش با کیفیت بالا دارد. این نیاز به دادهٔ آموزش برچسبدار یک مانع بزرگی برای کار کردن مدلهای یادگیری ماشین در دنیای واقعی مانند داخل یک سازمان یا صنعت است. این گلوگاه در راههای مختلفی خود را بروز میدهد. بهطور مثال:

تعداد ناکافی دادهٔ برچسبدار[ویرایش]

هنگامی که تکنیکهای یادگیری ماشین در کاربردی جدید شروع به کار میکنند، معمولاً دادهٔ آموزش به اندازهٔ کافی برای اعمال فرایندهای مرسوم نیست.[۵] هرچند بعضی صنایع این مزیت را دارند که مقدار کافی دادهٔ آموزش آماده دارند. جمعآوری دادهٔ آموزش نیاز به گذشت زمان بسیار زیاد و هزینهٔ بالا شود؛ بنابراین آنهایی که چنین نیستند ممکن است با مشکل جدی روبهرو شوند.

کمبود متخصصهای موضوع برای برچسب زدن داده[ویرایش]

هنگامی که train کردن داده نیازمند تخصصی دقیق و مرتبط با ویژگیهای دادهها است.[۵] بهطور مثال حوزههای زیستپزشکی یا مسائل امنیتی.

زمان ناکافی برای برچسب زدن و آمادهکردن[ویرایش]

بیشتر زمان پیادهسازی یادگیری ماشین روی آماده کردن مجموعه داده صرف میشود. هنگامی که یک بخش صنعتی یا یک مطالعهٔ میدانی با مشکلاتی روبهرو میشود که بهطور ذاتی مدام در حال دگرگونیاند، ممکن است جمعآوری و آمادهکردن سریع دادهٔ کافی امکانپذیر نباشد.[۵] بهطور مثال این موضوع در مسائل مرتبط با امنیت سایبری واضحتر دیده میشود.

انواع برچسب ضعیف[ویرایش]

برچسبهای ضعیف برای کاهش هزینه و افزایش کارایی تلاشهای انسانیای که روی فرایند دستی برچسب زدن داده صرف میشود که در سه گروه کلی قرار میگیرند:

- آمار سراسری روی گروههای ورودی: این محیط شامل دسترسی به اطلاعات سراسری روی کیسههای نمونهها میشود مانند دانستن اطلاعات آماری مثل میانگین از نصف برچسبهای یک زیرمجموعه داده.

- دستهبند ضعیف: این روش شامل این فرض است که به تعداد زیادی دستهبند ضعیف دسترسی داریم که بهطور ضعیف با تابع یادگیری اصلی مرتبط هستند. این دستهبندها ممکن است برچسبزنندههارا از یک سکوی جمعسپاری (کمک گرفتن از عموم مردم برای مشارکت در یک کار یا پژوهش) یا متخصصان مدل کنند. بهطور کلی توسعهدهندگان ممکن است از منابع موجود (مانند پایههای علمی یا مجموعه دادههای جایگزین یا مدلهای از قبل آموزش دیده) برای ساختن برچسبهای مفید استفاده کنند با آنکه ممکن است بهطور کامل مناسب کار مورد انتظار نباشند.

- یادداشتهای ناقص: نظارت ضعیف ممکن است به عنوان دسترسی به اطلاعات جزئی از هر برچسب تفسیر شود. این اطلاعات جزئی را میتوان به عنوان یک فرایند فساد درنظر گرفت. در برخی موارد مشاهدات جزئی را میتوان تبدیل به مجموعهای بالقوه از برچسبها کرد که با این مشاهده همخوانی دارند. این نظارت جزئی یک تعمیم روی یادگیری نیمه نظارتی است که روشی کلاسیک برای حل گلوگاه یادداشتگذاری دادهاست.

خارج از این سه محیط محدودیتهایی که یادگیری نظارتی ضعیف ممکن است پیش رو داشته باشد با اطلاعات انسانی به عنوان priorها اقدام به رفع آنها میکنند.

یادگیری نیمهنظارتشده[ویرایش]

یادگیری نیمهنظارتشده نوع خاصی از نظارت ضعیف است که بخشی کوچکی از دادهٔ برچسبدار را با مقدار زیادی دادهٔ بدون برچسب هنگام آموزش ترکیب میکند. این روش میان یادگیری بدون نظارت (با دادههای کاملاً بدون برچسب) و یادگیری نظارتشده (دادههای کاملاً برچسبدار) قرار میگیرد.

دادههای بدون برچسب هنگامی که در ترکیب با حجم کمی دادهٔ برچسبدار قرار میگیرد میتواند بهبود قابلتوجهی در دقت یادگیری به همراه داشتهباشد. در اختیار داشتن دادهٔ برچسبدار برای یک مسئلهٔ یادگیری عموماً نیاز به یک عامل انسانی بامهارت یا یک تجربهٔ فیزیکی دارد. هزینهٔ همراه فرایند برچسب زدن کل داده همراه پرهزینه و در عمل دور از دسترس است. از طرفی در اختیار گرفتن دادهٔ بدون برچسب هزینهای ندارد؛ بنابراین یادگیری نیمهنظارتی یک موضوع مورد توجه در یادگیری ماشین است و به عنوان مدلی از یادگیری انسانی نیز مورد توجه است.

مجموعهای از متغیرهای تصادفی مستقل با توزیع یکسان با برچسبهای متناظر و نمونهٔ بدون برچسب را درنظر بگیرید. یادگیری نیمه نظارتی این دو بخش را ادغام کرده که این روش کارایی بهتری از به کارگیری جداگانهٔ زیرمجموعههای برچسبدار یا بدون برچسب به صورت جدا دارد.

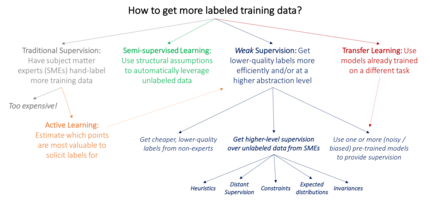

روشهای به دست آوردن دادههای برچسبگذاری شدهٔ بیشتر[۳][ویرایش]

روشهای سنتی[ویرایش]

در این روش از کارشناسان خبره میخواهیم که دادههای بیشتری را برچسبگذاری کنند

یادگیری فعال[ویرایش]

هدف اصلی رویکرد یادگیری فعال، ارائه نقاط دادهای است که برای مدل بسیار ارزشمند هستند یا میتوان گفت که نقاط داده جدیدی را انتخاب میکنیم که برای برچسب گذاری لازم است. به عنوان مثال، ما در تجزیه و تحلیل احساسات، احساسات عصبانی داریم که نزدیک به مرزهای تصمیم مدل است و در این مورد، از مجمعه خبرگان میخواهیم که فقط جملات شامل احساسات را برچسبگذاری کنند. یا فقط میتوانیم برای این نقاط داده به سمت نظارت ضعیفتر برویم تا یادگیری فعال بتواند با نظارت ضعیف تکمیل شود.

یادگیری نیمهنظارت شده[ویرایش]

هدف اصلی در پشت این رویکرد استفاده از مجموعه دادههای برچسبگذاریشده کوچک با مجموعه دادههای بدون برچسب بزرگ در سطح بالا با فرض معیارهای همواری و فاصله کم دادههای بدون برچسب است.

یادگیری انتقالی[ویرایش]

یادگیری انتقالی رویکردی است که در آن از یک مدل از پیش آموزش دیده برای یادگیری از دادههای موجود استفاده میشود. با استفاده از دانش بهدستآمده از آموزش در مجموعههای داده مختلف، اگر شباهتهایی بین مجموعه دادههای آموزشدیده قبلی و مجموعه داده هدف وجود داشته باشد، مدل از پیش آموزشدیده شده را میتوان در یک مجموعه داده جدید اعمال کرد. این فرایند امکان استفاده کارآمد از دانش قبلی را فراهم میکند و تطبیق مدلها با مجموعه دادههای جدید را تسهیل میکند.

انواع ورودیها در نظارت ضعیف[۶][ویرایش]

اکتشافی مبتنی بر الگو[ویرایش]

در این ورودی کارشناسان خبره الگوها را شناسایی و به عنوان ورودی کمکی قرار میدهند

نظارت از راه دور[ویرایش]

نظارت از راه دور تکنیکی است که از نقاط دادهای استفاده میکند که با یک پایگاه دانش خارجی همسو میشوند تا برچسبها را تولید کنند. نظارت از راه دور به جای تکیه صرف بر برچسبگذاری دستی، از روشهای اکتشافی برای تخصیص خودکار برچسبها بر اساس همسویی دادهها با دانش خارجی استفاده میکند.

طبقهبندیکنندههای ضعیف[ویرایش]

طبقهبندیکنندههای ضعیف با استفاده از طبقهبندیکنندههایی که ممکن است برای کار خاص مناسب نباشند، در نظارت ضعیف نقش دارند. در عوض، این طبقهبندیکنندهها به مجموعه دادههای متفاوتی اعمال میشوند و مجموعههای دادهای را ایجاد میکنند که نویز دار و مغرضانه هستند. سپس این مجموعه دادهها به عنوان مجموعه آموزشی برای فرایند یادگیری استفاده میشود. در حالی که طبقهبندیکنندهها ممکن است بهصورت جداگانه دقت مطلوبی را ارائه ندهند، مشارکت جمعی آنها به مدلهای آموزشی برای مدیریت سناریوهای مختلف و بهبود عملکرد کلی کمک میکند. با ترکیب طبقهبندیکنندههای ضعیف، نظارت ضعیف از منابع مختلف داده برای بهبود فرایند یادگیری استفاده میکند.

مولدهای تابع برچسبگذاری[ویرایش]

مولدهای تابع برچسبگذاری ابزارهایی در سیستمهای نظارت ضعیف مانند Snorkel هستند که امکان ایجاد چندین عملکرد را با استفاده از کد فراهم میکنند. این توابع با تخصیص خودکار برچسبها به دادهها، نقش مهمی در فرایند نظارت ضعیف بازی میکنند. با استفاده از کد قابل برنامهریزی، مولدهای تابع برچسبگذاری مقیاسپذیری و مدیریتپذیری را ارائه میدهند و امکان مدیریت کارآمد مجموعههای داده بزرگ را فراهم میکنند. این ابزارها کاربران را قادر میسازد تا عملکردهای برچسب گذاری را بر اساس الزامات خاص تعریف و سفارشی کنند و به انعطافپذیری و اثربخشی رویکردهای نظارت ضعیف کمک میکنند.

جستارهای وابسته[ویرایش]

منابع[ویرایش]

- ↑ «Weak Supervision: A New Programming Paradigm for Machine Learning». SAIL Blog. ۲۰۱۹-۰۳-۱۰. دریافتشده در ۲۰۲۲-۱۲-۳۰.

- ↑ Snorkel، Team (۲۰۲۲-۰۵-۱۷). «Weak supervision». Snorkel AI (به انگلیسی). دریافتشده در ۲۰۲۴-۰۳-۰۲.

- ↑ ۳٫۰ ۳٫۱ «A Complete Guide to Weak Supervision in Machine Learning». Analytics India (به انگلیسی). ۲۰۲۱-۱۰-۰۳.

- ↑ الگوهای پردازش زبانهای طبیعی. «نظارت». دریافتشده در ۲۰۲۴-۰۳-۰۲.

- ↑ ۵٫۰ ۵٫۱ ۵٫۲ ۵٫۳ Roh, Yuji; Heo, Geon; Whang, Steven Euijong (2019-08-12). "A Survey on Data Collection for Machine Learning: a Big Data -- AI Integration Perspective". arXiv:1811.03402 [cs, stat].

- ↑ "1. Introduction to Weak Supervision - Practical Weak Supervision [Book]". www.oreilly.com (به انگلیسی). Retrieved 2023-06-29.